维基百科词向量 sgns.wiki.char.bz2解压后文件后缀名是.char, 可以通过一些方法得到.txt结尾的文件,有35万多个字词和符号,300维的向量表示。将词向量作为词嵌入层时需要加载全部的词向量到内存,如果计算机的内存...

”维基百科 维基百科中文词向量 中文词向量“ 的搜索结果

词向量 词向量_基于中文维基百科的词向量构建+可视化

word2vec预训练模型,gensim做的

你将使用Gensim和维基百科获得你的第一批中文词向量,并且感受词向量训练的基本过程。 词向量原理详解请参考: 词向量技术原理及应用详解(一) 词向量技术原理及应用详解(二) 词向量技术原理及应用详解(三...

使用维基百科训练简体中文词向量-附件资源

基于中文维基百科的词向量构建及可视化-附件资源

这是最新的中文维基百科语料库(截至2019年2月20日),可以用来训练word2vec词向量,做文本分类,官网特别难下载,因此分享出来

数据来源于中文维基百科,利用gensim进行数据抽取,再经过繁体字转换成简体字,得到纯净的文本语料,可用于词向量训练。

维基百科语料库:1.http://ftp.acc.umu.se/mirror/wikimedia.org/dumps/enwiki/20180320/2.https://meta.wikimedia.org/wiki/Mirroring_Wikimedia_project_XML_dumps3.https://dumps.wikimedia.org/生成词向量教程:...

GloVe模型选择测试的一个小型语料库,50维的词向量

基于中文维基百科文本数据训练词向量 一,数据获取 本词向量利用的是中文维基百科的语料进行训练。 语料地址: (大小1.16G) 也可以在我的网盘上下载:链接: 提取码:ihu4 二,数据转换 原数据的格式是xml,我们...

主要参考: https://blog.csdn.net/weixin_40547993/article/details/97781179 ... 其他的可能还有一些,查阅的时候没注意,后来找不到了(⊙﹏⊙) 本文使用的语料库是维基百科中文语料库截至2...

说明:由于在学习自然语言处理,读了很多篇博文,就想着动手实验一下,本文主要参考了中英文维基百科语料上的Word2Vec实验,其中在实验阶段出现了一些预期之外的错误,参考其他博文进行了微调。这篇博文更像是篇错误...

中文维基glove词向量(已训练)-part2中文维基glove词向量(已训练)-part2

维基百科简体中文语料训练word2vec词向量 步骤: 1.下载维基百科中文语料 2.使用工具从压缩包中抽取正文文本 3.将繁体字转简体字 4.分词 5.训练模型 6.测试模型 1.下载维基百科中文语料 语料下载地址:...

使用glove预训练词向量(1.6GB维基百科语料),维度为300,词汇量约13000,文件大小为41.2MB

中文语料库训练数据集

境: Win10 +Anaconda(自带Python3.6) IDE: Pycharm (其Interperter使用的是Anaconda自带的Python3.6) 安装Gensim库: ...在Anaconda Prompt中输入: ...1.首先获取维基百科语料库资源 https://dumps.wiki...

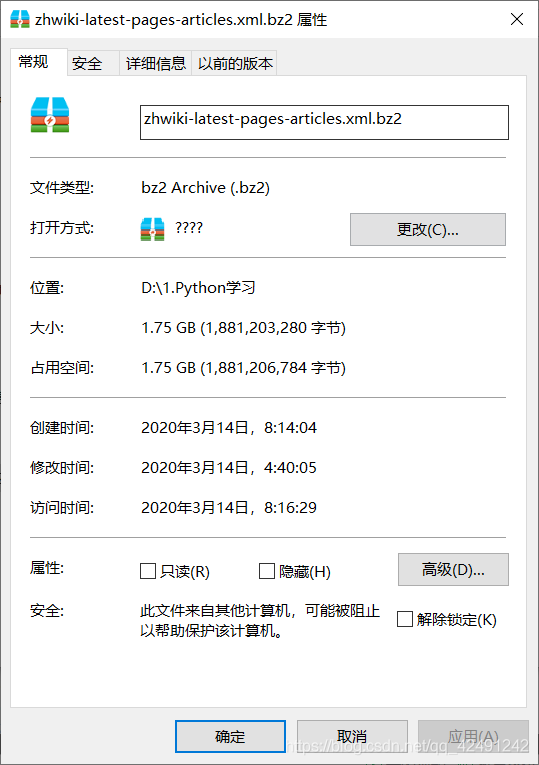

下载中文维基百科语料数据:wiki_data_1.4g 三、word2vec步骤: 1. 将xml的wiki数据转换成text数据 先将zhwiki-latest-pages-articles.xml.bz2文件复制到process.py所在目录下,cmd进入process.py文件所在目录,...

enwiki-latest-pages-articles1.xml-p10p30302.bz2,维基百科用来训练英文word2vec词向量的语料

词向量嵌入需要高效率处理大规模文本语料库。word2vec。简单方式,词送入独热编码(one-hot encoding)学习系统,长度为词汇表长度的向量,词语对应位置元素为1,其余元素为0。向量维数很高,无法刻画不同词语的语义...

本文通过对中文维基百科数据的处理用来训练word2vec模型,更深入的了解词向量模型的训练过程,并且对文本的处理进行掌握 python代码如下所示(添加详细注释): # -*-coding: UTF-8 -*- # @Time:2019/8/28 19:02 ...

推荐文章

- YOLO V8车辆行人识别_yolov8 无法识别路边行人-程序员宅基地

- jpa mysql分页_Spring Boot之JPA分页-程序员宅基地

- win10打印图片中间空白以及选择打印机预览重启_win10更新后打印图片中间空白-程序员宅基地

- 【加密】SHA256加盐加密_sha256随机盐加密-程序员宅基地

- cordys 启动流程_cordys服务重启-程序员宅基地

- net中 DLL、GAC-程序员宅基地

- (一看就会)Visual Studio设置字体大小_visual studio怎么调整字体大小-程序员宅基地

- Linux中如何读写硬盘(或Virtual Disk)上指定物理扇区_dd写入确定扇区-程序员宅基地

- python【力扣LeetCode算法题库】面试题 17.16- 按摩师(DP)_一个有名的讲师,预约一小时为单位,每次预约服务之间要有休息时间,给定一个预约请-程序员宅基地

- 进制的转换技巧_10111100b转换为十进制-程序员宅基地